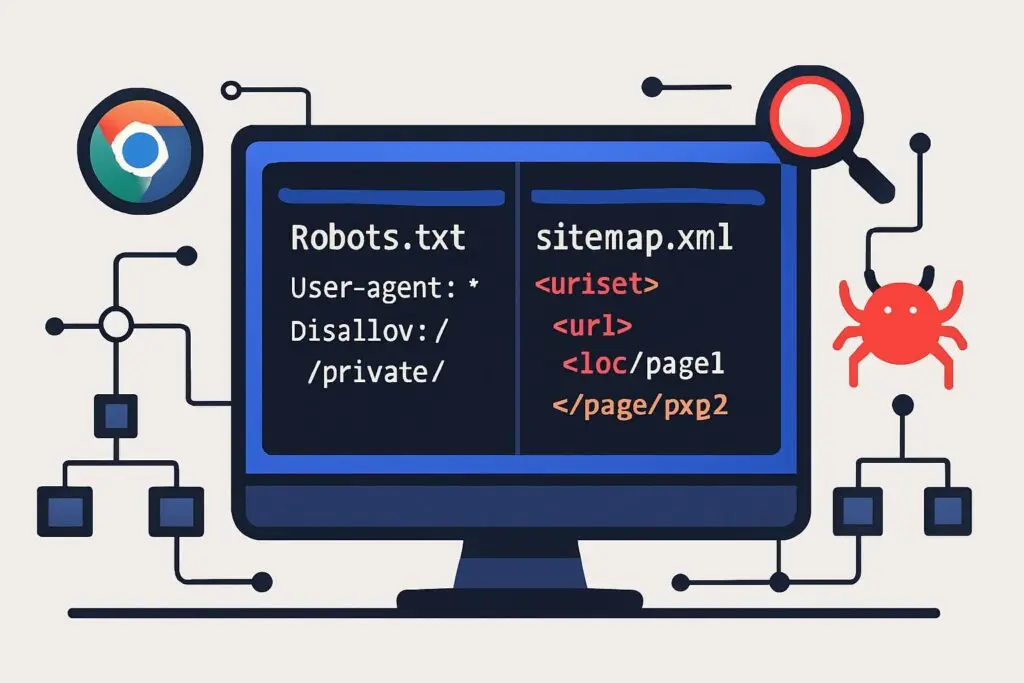

در دنیای وسیع اینترنت، وبسایت شما مانند یک کتابخانه عظیم و ارزشمند است. رباتهای گوگل، کتابداران خستگیناپذیری هستند که قفسهها (صفحات) را بررسی میکنند تا محتوای شما را فهرستبندی کرده و به کاربران نیازمند ارائه دهند. اما چگونه میتوان به این کتابداران هوشمند گفت که کدام بخشها “ورود ممنوع” و کدام بخشها “اولویت بازدید” هستند؟ پاسخ در دو فایل به ظاهر ساده اما فوقالعاده قدرتمند نهفته است: Robots.txt و Sitemap.xml. بهینهسازی این دو فایل، ستون فقرات سئو تکنیکال و کلید مدیریت نحوه تعامل موتورهای جستجو با وبسایت شماست. در این مقاله جامع، به شما نشان خواهیم داد چگونه با تسلط بر این دو ابزار، فرآیند خزش گوگل را هدایت کرده و رتبه سایت خود را به طور چشمگیری بهبود بخشید.

نگهبان دروازه: تشریح کامل فایل Robots.txt

فایل Robots.txt یک فایل متنی ساده است که در ریشه (root) دامنه شما قرار میگیرد (مثلاً yourdomain.com/robots.txt) و به رباتهای موتور جستجو (که به آنها User-agent گفته میشود) دستورالعملهایی ارائه میدهد. این فایل مشخص میکند که رباتها مجاز به خزش کدام بخشها از وبسایت شما هستند و کدام بخشها را باید نادیده بگیرند. درک این نکته حیاتی است که Robots.txt یک پروتکل پیشنهادی است، نه یک دیوار امنیتی. رباتهای معتبر مانند گوگل از آن پیروی میکنند، اما رباتهای مخرب ممکن است آن را نادیده بگیرند.

دستورات کلیدی در فایل Robots.txt

ساختار این فایل بر پایه چند دستور ساده بنا شده است:

- User-agent: این دستور مشخص میکند که قوانین بعدی برای کدام ربات اعمال میشود. برای مثال،

User-agent: Googlebotفقط ربات گوگل را هدف قرار میدهد، در حالی کهUser-agent: *به معنای “همه رباتها” است. - Disallow: این دستور به ربات میگوید که یک مسیر، فایل یا دایرکتوری خاص را خزش نکند. برای مثال،

Disallow: /admin/از خزش پوشه ادمین جلوگیری میکند. - Allow: این دستور که معمولاً در ترکیب با

Disallowاستفاده میشود، یک استثنا ایجاد میکند. برای مثال، اگر کل پوشهwp-adminرا مسدود کرده باشید اما نیاز دارید یک فایل خاص در آن خزش شود، میتوانید از این دستور استفاده کنید:Disallow: /wp-admin/Allow: /wp-admin/admin-ajax.php - Sitemap: از این دستور برای مشخص کردن آدرس نقشه سایت (Sitemap) خود استفاده میکنید. این کار به رباتها کمک میکند تا به سرعت نقشه راه وبسایت شما را پیدا کنند:

Sitemap: https://yourdomain.com/sitemap.xml

چگونه Robots.txt را برای سئو بهینه کنیم؟ (بهینهسازی بودجه خزش)

مفهوم بودجه خزش (Crawl Budget) به تعداد صفحاتی اشاره دارد که ربات گوگل در یک بازه زمانی مشخص روی سایت شما خزش میکند. با مسدود کردن دسترسی به صفحات بیاهمیت، شما بودجه خزش خود را برای صفحات کلیدی و ارزشمند ذخیره میکنید.

صفحاتی که باید Disallow شوند:

- صفحات مدیریت و ورود: پوشههایی مانند

/wp-admin/یا/admin/هیچ ارزش سئویی ندارند. - نتایج جستجوی داخلی: صفحاتی که با پارامترهای جستجو ایجاد میشوند (مانند

/?s=keyword) محتوای تکراری تولید میکنند و باید مسدود شوند. - صفحات سبد خرید و تسویه حساب: این صفحات برای کاربران شخصیسازی شدهاند و نیازی به ایندکس شدن ندارند.

- فایلهای داخلی و اسکریپتها: فایلهای موقت، لاگها یا اسکریپتهای داخلی که برای کاربران نهایی نیستند.

- صفحات تشکر (Thank You Pages): این صفحات معمولاً محتوای ضعیفی دارند و بهتر است خزش نشوند.

اشتباه مرگبار: هرگز فایلهای CSS و JS را Disallow نکنید!در گذشته، مسدود کردن فایلهای CSS و JavaScript یک عمل رایج بود. اما امروزه، گوگل برای درک کامل محتوا و تجربه کاربری، نیاز به رندر کردن کامل صفحه دارد. مسدود کردن این فایلها باعث میشود گوگل نتواند سایت شما را به درستی ببیند و این امر به شدت به سئوی شما آسیب میزند.

نقشه راه سایت: تسلط بر Sitemap.xml

اگر Robots.txt نگهبان دروازه است، Sitemap.xml نقشه راه دقیق و جامعی است که شما به کتابداران گوگل ارائه میدهید. این فایل با فرمت XML، لیستی از تمام URLهای مهم وبسایت شما را که مایل به ایندکس شدن آنها هستید، در اختیار موتورهای جستجو قرار میدهد. این نقشه به گوگل کمک میکند تا صفحات جدید را سریعتر کشف کند، ساختار سایت شما را بهتر درک کند و از هیچ صفحه مهمی غافل نشود.

چرا Sitemap.xml برای سئو حیاتی است؟

- کشف سریعتر محتوا: برای وبسایتهای جدید یا وبلاگهایی که به طور مرتب محتوای جدید منتشر میکنند، نقشه سایت سریعترین راه برای اطلاعرسانی به گوگل است.

- سایتهای بزرگ و پیچیده: در سایتهای با هزاران صفحه و ساختار تو در تو، نقشه سایت تضمین میکند که صفحات عمیق نیز توسط خزندهها پیدا میشوند.

- لینکسازی داخلی ضعیف: اگر برخی صفحات شما لینکهای ورودی مناسبی ندارند (صفحات یتیم)، نقشه سایت تنها راه کشف آنها توسط گوگل است.

بهینهسازی Sitemap.xml برای حداکثر کارایی

یک نقشه سایت خوب، فقط فهرستی از URLها نیست. برای بهینهسازی آن به نکات زیر توجه کنید:

- تمیز و بهروز نگه دارید: نقشه سایت شما باید فقط شامل URLهای اصلی (Canonical)، با کد وضعیت ۲۰۰ (OK) باشد. از قرار دادن URLهای ریدایرکت شده (۳۰۱)، صفحات حذف شده (۴۰۴) یا صفحاتی که با تگ

noindexعلامتگذاری شدهاند، جداً خودداری کنید. - از نقشه سایت داینامیک استفاده کنید: به جای ساخت دستی، از ابزارها و افزونههایی (مانند Yoast SEO یا Rank Math برای وردپرس) استفاده کنید که به طور خودکار با افزودن یا حذف محتوا، نقشه سایت را بهروز میکنند.

- نقشههای سایت بزرگ را تقسیم کنید: گوگل برای هر نقشه سایت، محدودیت ۵۰,۰۰۰ URL و حجم ۵۰ مگابایت را تعیین کرده است. اگر سایت شما بزرگتر است، آن را به چند نقشه کوچکتر تقسیم کرده و از یک فایل Sitemap Index برای ارجاع به همه آنها استفاده کنید.

- اطلاعات تکمیلی را اضافه کنید (با احتیاط): تگهایی مانند

<lastmod>(آخرین تاریخ ویرایش) بسیار مهم هستند و به گوگل سیگنال میدهند که محتوا بهروز شده است. تگهای<changefreq>و<priority>امروزه توسط گوگل اهمیت کمتری دارند، اما استفاده صحیح از<lastmod>یک مزیت محسوب میشود.

هماهنگی استراتژیک: جادوی ترکیب Robots.txt و Sitemap.xml

قدرت واقعی زمانی آشکار میشود که این دو فایل در هماهنگی کامل با یکدیگر کار کنند. Robots.txt به گوگل میگوید “کجا نرو” و Sitemap.xml میگوید “حتماً اینجا را ببین”. بزرگترین اشتباهی که میتوانید مرتکب شوید، ارسال سیگنالهای متناقض است.

قانون طلایی: هرگز یک URL را که در Sitemap.xml قرار دادهاید، در Robots.txt مسدود (Disallow) نکنید.

این کار گوگل را به شدت سردرگم میکند. گوگل URL را از نقشه سایت شما میبیند اما Robots.txt به او اجازه خزش نمیدهد. در چنین حالتی، ممکن است گوگل آن URL را بدون محتوا ایندکس کند که نتیجه آن نمایش یک عنوان بیربط و بدون توضیحات در نتایج جستجو خواهد بود (چیزی شبیه به “دسترسی به این صفحه با robots.txt مسدود شده است”).

نتیجهگیری

بهینهسازی فایلهای Robots.txt و Sitemap.xml دیگر یک انتخاب نیست، بلکه یک ضرورت در دنیای رقابتی سئو است. این دو فایل، ابزارهای ارتباطی شما با گوگل هستند. با استفاده هوشمندانه از Robots.txt، شما بودجه خزش خود را مدیریت کرده و تمرکز گوگل را بر روی ارزشمندترین داراییهای محتوایی خود معطوف میکنید. با ارائه یک Sitemap.xml تمیز و بهروز، فرآیند کشف و ایندکس شدن صفحات خود را سرعت میبخشید و تضمین میکنید که هیچ محتوای باارزشی از دید گوگل پنهان نمیماند. همین امروز این دو فایل را در وبسایت خود بازبینی کنید و کنترل کامل نحوه دیده شدن خود در بزرگترین موتور جستجوی جهان را به دست بگیرید.

سوالات متداول (FAQ)

۱. تفاوت اصلی بین دستور Disallow در Robots.txt و تگ noindex چیست؟

این یک تمایز بسیار مهم است. دستور Disallow در Robots.txt از خزش (Crawling) یک صفحه توسط رباتها جلوگیری میکند؛ یعنی ربات گوگل اصلاً وارد آن صفحه نمیشود تا محتوای آن را بخواند. اما تگ meta name="robots" content="noindex" که در <head> یک صفحه قرار میگیرد، به ربات اجازه خزش میدهد، اما به او میگوید که این صفحه را در نتایج جستجو ایندکس (Index) نکند. اگر صفحهای قبلاً ایندکس شده و میخواهید آن را حذف کنید، باید از تگ noindex استفاده کنید، نه Disallow.

۲. آیا واقعاً باید فایلهای CSS و JavaScript خود را برای خزش باز بگذارم؟

بله، قطعاً. گوگل از الگوریتمی به نام “Mobile-First Indexing” استفاده میکند و برای ارزیابی کامل یک صفحه، نیاز دارد آن را همانطور که یک کاربر میبیند، رندر کند. مسدود کردن دسترسی به فایلهای CSS (برای استایلدهی) و JS (برای عملکرد تعاملی) باعث میشود گوگل نتواند صفحه را به درستی ببیند و ممکن است آن را به عنوان یک صفحه با تجربه کاربری ضعیف ارزیابی کند که به رتبه شما آسیب جدی میزند.

۳. چگونه میتوانم یک فایل Sitemap.xml برای سایتم ایجاد کنم؟

برای سیستمهای مدیریت محتوا مانند وردپرس، افزونههای سئو محبوبی مانند Yoast SEO، Rank Math یا All in One SEO به طور خودکار و داینامیک یک نقشه سایت کامل برای شما ایجاد و مدیریت میکنند. برای سایتهای استاتیک یا سفارشی، میتوانید از ابزارهای آنلاین تولیدکننده نقشه سایت (Sitemap Generator) استفاده کنید که سایت شما را خزش کرده و فایل XML را برای شما تولید میکنند.

۴. اگر یک URL هم در نقشه سایت باشد و هم در Robots.txt مسدود شده باشد، چه اتفاقی میافتد؟

این یک سیگنال متناقض به گوگل است. گوگل URL را از نقشه سایت پیدا میکند اما به دلیل دستور Disallow، قادر به خزش آن نخواهد بود. نتیجه این است که گوگل ممکن است URL را ایندکس کند اما چون محتوای آن را ندیده، نمیتواند عنوان و توضیحات مناسبی برای آن در نتایج جستجو نمایش دهد. این وضعیت به عنوان یک خطا در گوگل سرچ کنسول نیز گزارش میشود و باید سریعاً برطرف گردد.

۵. هر چند وقت یکبار باید نقشه سایت خود را بهروزرسانی و ارسال کنم؟

در حالت ایدهآل، نقشه سایت شما باید داینامیک باشد و با هر تغییر در محتوای سایت (انتشار مقاله جدید، حذف یک محصول و غیره) به طور خودکار بهروز شود. پس از راهاندازی اولیه و معرفی آدرس نقشه سایت در گوگل سرچ کنسول و فایل Robots.txt، نیازی به ارسال مجدد آن پس از هر بهروزرسانی نیست. گوگل به طور دورهای آن را بررسی خواهد کرد. اگر تغییرات بسیار بزرگی در ساختار سایت خود ایجاد کردید، ارسال مجدد آن میتواند به تسریع فرآیند کمک کند.